“范式变化这个词在AI圈子被用的有点叙事过载了。”

在本来策动的春节首发时刻点昔时两个多月后,DeepSeek V4终于认真发布。关于这一代模子,外界有着极高的热心度,但也伴跟着诸多疑问:为何经验了如斯永劫刻的推迟?在内容应用中发挥怎样?

近日,两位一线AI研发与算力框架从业者(刘易峰与赵晨阳)在播客中对V4的技巧证明进行了详备的斟酌。他们方位的团队以致在V4发布本日,就完成了推理和强化学习两条链路的跑通。本文将基于他们的实测反馈与技巧判辨,为您收复一个确切的DeepSeek V4。

智力稳居第一梯队,但堕入“Token耗尽”窘境

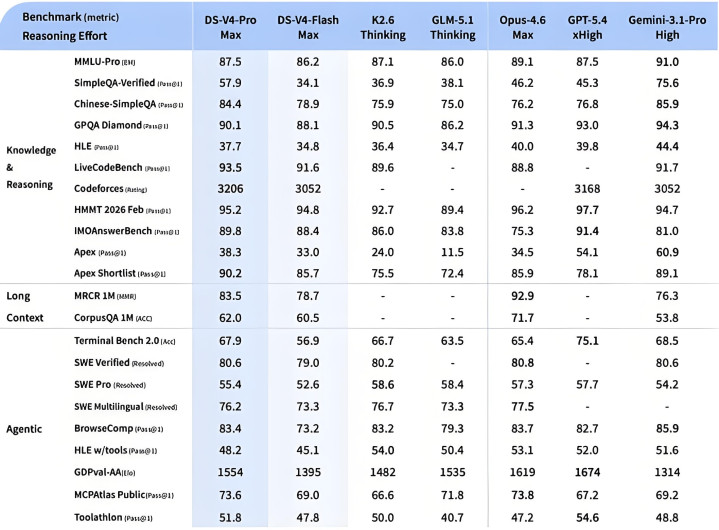

在模子发布后,测试其确切智力的直不雅方法即是进行“盲测”。现在在Arena竞技场等主流盲测平台上,V4简陋排在第23位控制,其玄虚评分与千问3.5 Max、GLM 5.1、Kimi K2.6等国内第一梯队模子处于归并区间。

从内容使用体感来看,在数学推理、代码编写以及罢免Agent(智能体)指示实施方面,V4比上一代的V3有权贵升迁,且幻觉发生率大幅度减少。不外,在最中枢的代码智力上,与现在海外顶尖的闭源模子(如Claude、GPT的最新版块)比较,仍存在一定差距。

但在各项智力升迁的背后,从业者们不雅察到了一个普遍存在且亟待惩办的问题——算力资源的耗损扬厉。

在使用V4及同类最新模子惩办归并个问题时,模子耗尽的Token(词元)数目比以前大了许多。从业者将其姿色为“拿着高压水枪浇花”。这并非模子自己的颓势,而是模子诚实响应了其受到的强化学习训练方针:模子倾向于用更长的推理设施来确保拿到正确的最终奖励。天然V4通过底层优化极地面镌汰了单Token的生成老本(其Flops仅占V3.2的27%,KV缓存仅占10%),但惩办单一问题总时长的加多,标明通盘这个词行业需要从头想考:在追求极长高下文的同期,怎样提高模子愚弄高下文的内容效果。

四项底层技巧的“组合爆炸”

V4之是以比预期晚了两个多月发布,很猛进度上是因为它并非在原有框架上作念粗略的修补,而是一次性引入了四个彼此高度耦合的底层新特质。在极其广泛的模子规模上,单独上线任何一个新功能都需要极大规模的排错考据,四个技巧重叠,径直导致了工程上的“组合爆炸”。

1. 断念MLA,重构混杂细心力机制 在V3期间,DeepSeek建议了MLA架构,并被后续诸多开源模子(如Kimi K2系列、GLM 5系列)世俗选拔。但在V4中,研发团队烧毁了这一技巧,转而选拔了混杂滑动窗口(SWA)与长程细心力的机制。具体而言,模子在不同的汇聚层中,会事前界说使用CSA(在序列维度作念4:1压缩)如故SCA(作念128:1的极点压缩保握盛大)。疏淡层负责锁定环节信息,盛大层提供语义概览。这种重构大略大幅升迁百万字长文本的处理效果,但给底层的缓存一致性(尤其是前缀缓存机制)带来了极大的拓荒难度。

2. 引入MHC(多头贯穿)拓展信息流 传统的Transformer架构中,信息频繁是逐层传递的。V4选拔了MHC技巧,十分于在层与层之间径直竖立更宽的信息通说念。这种作念法能权贵提高逻辑推明智力,使得信息不需要恭候一层层慢慢传递。然而,这种跨层贯穿在数学旨趣上容易导致梯度回传极不褂讪(发生爆炸或隐藏)。V4通过特定的算法将信息流的规模严格截止为1,才得以将其告成应用到工业级大模子中。

3. 全面转向Muon优化器 模子训练优化的主流用具曾遥远是AdamW,它针对单个元素进行更新。而V4全面选拔了基于矩阵举座更新的Muon优化器。通过将通盘这个词矩阵视为一个举座,各元素之间的秩序更为一致,从而加速抑制速率。V4以致在此基础上找到了一个更为精确的全局学习率参数(0.18)。但这也意味着,能上下分的捕鱼app在散播式训练时,工程师必须对广泛的矩阵进行更为复杂的切分和通讯改换,极其考验底层的工程达成智力。

4. 攻克FP4极限精度的工程落地 将浮点数的数据存储位宽从FP8进一步压缩至FP4,是斩断显存容量和数据读取带宽瓶颈的环节技巧。但由于FP4的数值规模极其窄小,训练中极易出现梯度溢出。为了惩办这一清贫,研发团队使用了“量化感知训练”:在训练阶段将FP32的主权重模拟压缩到FP4规模,再无损反量化回FP8进行缱绻(使模子顺应低精度吃亏);而在信得过的强化学习采样阶段,则使用确切的FP4权重(达成W4A4级别的物理提速)。

隐藏的训练老本与极限的激活参数

在V3发布时,官方曾明确显露其终末一次训练老本为557万好意思元。但在V4的技巧证明中,这一数据隐藏了。

从业者分析觉得,不再主动公开老本,记号着研发团队不再需要依靠单一的“廉价”标签来界说自身。最终模子终末一次的训练跑通,只是是一皆老本的冰山一角。在此之前,大量的前沿技巧探索、对比执行、东说念主力以及数据筛选所耗尽的资金,常常是最终一次训练老本的几十倍。

与此同期,证明中显露了另一个值得行业热心的数据:V4 Pro的总参数达到了1.6万亿(1.6T),但其在处理任务时的激活参数仅为500亿控制,激活比例刚刚率先3%。

现在行业内同期的顶尖模子,如千问3.5 Max激活比例为4.3%,GLM 5.1为5.3%,Kimi K2.6为3.2%。V4进一步向下试探了激活比例的极限。MOE(混杂民众模子)的中枢价值即是将“总学问量”与“单次推理老本”解绑,V4将这种解绑推向了极致。在领有1.6万亿参数储备的同期,仅用少许的算力进行精确陈述。在如斯广泛的参数基数下,大略保证大量民众模块训练的负载平衡和路由分派不出错,阐述注解了团队在工程机制上的深厚积贮。

评测危境与基础生态成立

在算力生态方面,V4的技巧证明中明确提到,其在推理层面原生相沿了华为昇腾等国产芯片,并完成了技巧考据。在底层算子编写上,它也大量选拔了国内发展起来的开源编译说话(如Triton和Talon),这极地面镌汰了新算法拓荒高性能内核的边缘老本。

面对近期密集发布的各大模子,业内也濒临着一种“评测危境”(Evaluation Crisis)。现存的基准测试(Benchmark)一朝发布,常常在半年到一年内就会被各家模子“刷满”至90分以上。然而,在内容玩忽复杂的长程对话或代码合并等确切场景时,用户还是能感受到昭着的互异。无法准确评估,就无法提示正确的优化想法。怎样竖立针对智能体(Agent)和多步复杂任务的更可靠评测体系,将是全行业下一步的重点。

纵不雅V4的发布,它并莫得在“原生多模态”等主张上过度着墨,而是极其求实地弃取了深挖文本处理与底层缱绻效果。正如斯次发布时官方援用的《荀子》名言:“率说念而行,端然正己……不囿于誉,不恐于谤。” 交代延长发布的表里压力,将长高下文、极低激活比例、极低单Token老本的工程配方澈底跑通并考据,DeepSeek V4成立了开源大模子全国的一项全新工业规范。

结语

跟着各大模子高下文长度的连续冲破,您在广泛使用AI时能上下分的捕鱼,是否也遭受过模子为了完成任务而“过度啰嗦”的情况?关于未来大模子的发展,您更垂青其“反应速率与老本”,如故更期待其具备信得过清闲完成复杂责任的“智能体”智力?接待在驳斥区共享您的确切体验。

HG真人游戏官方网站

备案号:

备案号: